Компания: CARELY Group (производство косметики)

Оборот: ~2 млрд ₽ в год

Каналы продаж:

~50% — маркетплейсы

~50% — сеть «Золотое яблоко»

Продукты: 3 бренда косметики: Verifique, Structura, ART&FACT (~400 SKU, ~2 млн клиентов)

Особенность: полный цикл — от производства до аналитики внутри компании

Оборот: ~2 млрд ₽ в год

Каналы продаж:

~50% — маркетплейсы

~50% — сеть «Золотое яблоко»

Продукты: 3 бренда косметики: Verifique, Structura, ART&FACT (~400 SKU, ~2 млн клиентов)

Особенность: полный цикл — от производства до аналитики внутри компании

Несмотря на позиционирование как Data-Driven, в компании наблюдались системные сложности:

- Данные собирались медленно (дни вместо минут)

- Высокая зависимость от дата-инженеров

- Частые ошибки в отчетности (например, потеря ~200 тыс. ₽ в P&L)

- Ручная агрегация данных из множества источников: 1С, Airtable, Excel, маркетплейсы, Jira / Tempo, платёжные системы

Как сделать данные понятным и доступным инструментом для команды.

Экстрактор, сырой слой DWH и архитектура, которая выдерживает рост данных.

Мифы о data-driven и почему 90% компаний на самом деле не Data-Driven.

Гипотезы (мифы), которые не сработали

Миф 1: «Найм IT-специалистов решит проблему»

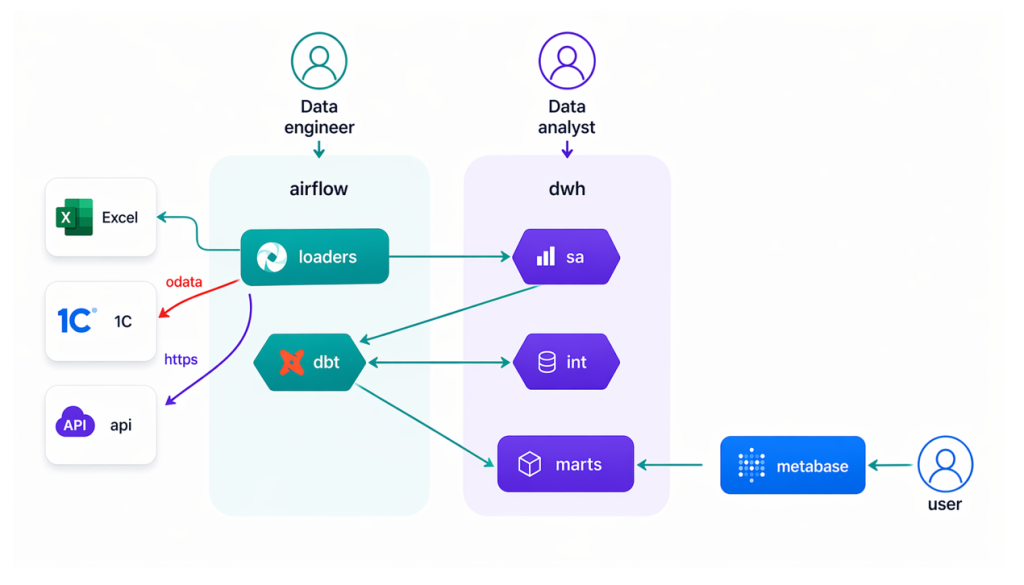

Что сделали:

- Внедрили DWH (Postgres / ClickHouse)

- Использовали Airflow, DBT, Metabase

- Настроили ETL через OData

- Полная выгрузка данных → нагрузка росла вместе с объемом

- ETL выполнялся часами

- Ночные падения без мониторинга

Аналитик → Дата-инженер → Код → Исправления

Итог: медленно, дорого, нестабильно

Технологический ландшафт:

Проблемы

- Документов становится всё больше, мы выгружаем их полностью, и это занимает часы

- Пока идёт выгрузка — база перегружена, поэтому запускать её можно только ночью

- Если выгрузка падает — всё начинается сначала, и отчёты снова задерживаются

- Любая задача требует аналитика и data-инженера, поэтому изменения в аналитике делаются медленно

Миф 2: «Нанимаем специалиста по 1C и становимся data-driven»

Задача:

Автоматически фиксировать поступление товара на склад

Проблема:

В 1С слишком сложная структура документов

Невозможно быстро определить нужное событие

Много итераций — без результата

Итог: автоматизация не достигнута

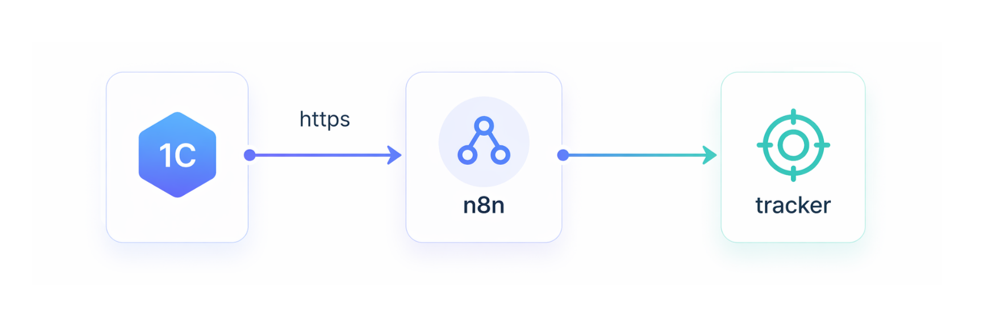

Интеграция 1С и таск-трекера

Идея: завести авто-задачу при первом поступлении товара на склад.

- Создание продукта — сложный процесс, он управляется в трекере задач, а не в 1С

- Чтобы процесс продолжался, важно знать, когда продукт впервые поступил на склад

ПРОБЛЕМЫ В ЭТОЙ ИНТЕГРАЦИИ

- С трудом выбрали документ для подписки

- С первого раза заработало неверно

- Долгие итерации

- Наладить так и не смогли

Миф 3: «Назвались data-driven и стали data-driven»

Реальность:

- Формально есть DWH и BI

- Фактически:

данные разрознены

ошибки неизбежны

3 бренда косметики

400+ SKU

1.8 + млрд оборот компании

50% занимает доля маркетплейсов

Кажется, что достаточно:

- нанять аналитиков

- завести DWH

- собрать дашборды

Но реальность сложнее …

Ключевая причина проблем:

Главная проблема — архитектура работы с данными, а не отсутствие инструментов.

- Полные выгрузки вместо инкрементальных

- Отсутствие событийной модели (CDC)

- Зависимость от разработчиков

- Нет автоматической доставки данных

Задача: P&L группы компаний

Чтобы построить P&L, нам уже нужно было выгружать огромный объём данных из 1С

- продажи и себестоимость

- движение безналичных средств

- зарплаты и начисления

- внутреннее потребление

- казначейство

- сроки РБП

И ещё дополнительные данные вне 1С

- Airtable — платежи и финансы ИП

- SolarStaff — подрядчики

- Jira + Tempo — трудозатраты

- Excel — учёт подрядчиков

- ЛК клиентов — логистика

И тут становится понятно: почему PNL собирался руками

Решение:

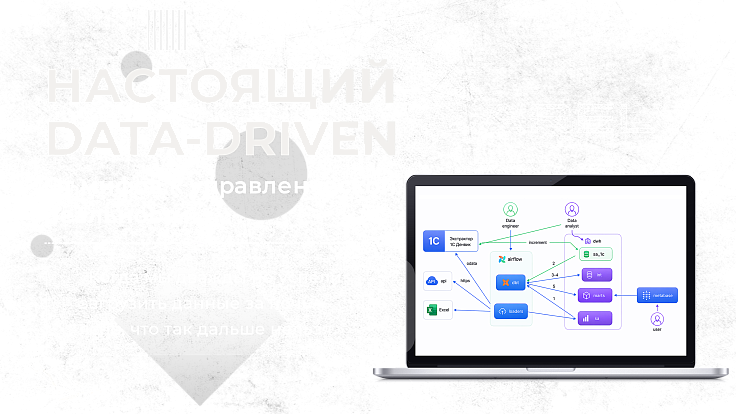

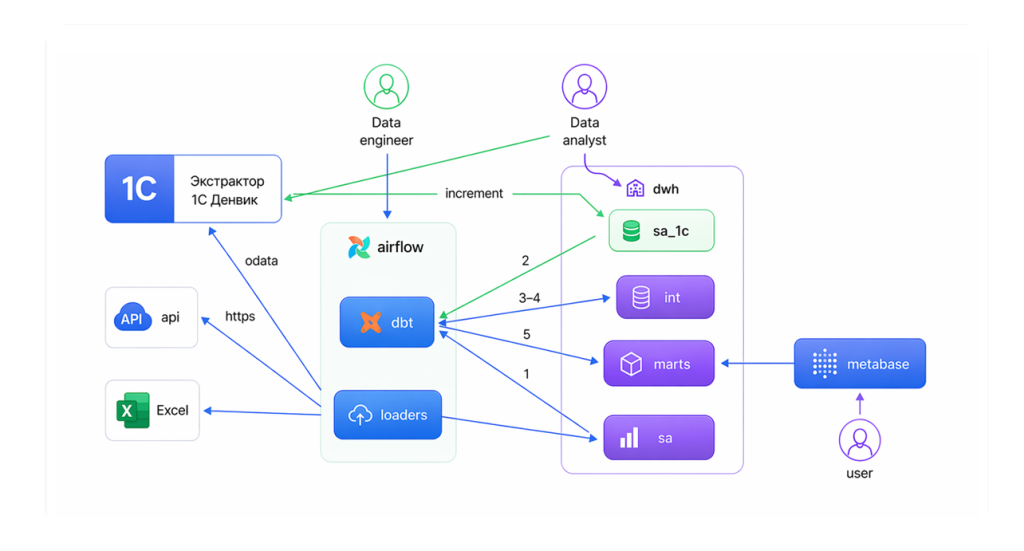

Внедрение продукта Экстрактор 1С (Денвик Аналитика)Что изменилось:

| Было | Стало |

|---|---|

| Полная выгрузка | Инкрементальная (CDC) |

| ETL по расписанию | Событийная загрузка |

| Нагрузка от объема | Нагрузка от изменений |

| Дата-инженеры в каждой задаче | Аналитики работают сами |

Как работает новое решение

Архитектура

- Аналитик находит нужные документы в 1С

- Настраивает подписку на изменения

- При изменении данных: событие фиксируется, а данные автоматически отправляются в DWH

- При сбое — автоматический retry

Скачать презентацию с выступления на Data+AI 2026

Видео с выступления на Data+AI 2026:

Ключевые инсайты и выводы

Технические эффекты

- Доставка данных: с дней → до минут

- Отказ от ночных ETL

- Отсутствие пропусков данных

- Снижение нагрузки на 1С

Бизнес-эффекты

- Устранение ошибок в отчетности

- Быстрое принятие решений

- Снижение затрат на разработку

- Уменьшение зависимости от IT

Организационные изменения

- Аналитики стали самостоятельными

- Дата-инженеры переключились на сложные задачи

- Упростилась коммуникация с бизнесом

Общий итог

Компания прошла путь от:

❌ сложной, медленной и дорогой аналитики

к:

✅ быстрой, событийной и управляемой системе данных

❌ сложной, медленной и дорогой аналитики

к:

✅ быстрой, событийной и управляемой системе данных

1. Data-Driven — это не про инструменты

Наличие DWH и BI ≠ Data-Driven

2. Важна событийная модель (CDC)

Инкрементальные изменения → основа эффективности

3. 1С — не проблема, а актив

Это структурированный источник данных, если правильно подключить

4. Самообслуживание аналитиков — критично

Чем меньше посредников — тем быстрее бизнес

Наличие DWH и BI ≠ Data-Driven

2. Важна событийная модель (CDC)

Инкрементальные изменения → основа эффективности

3. 1С — не проблема, а актив

Это структурированный источник данных, если правильно подключить

4. Самообслуживание аналитиков — критично

Чем меньше посредников — тем быстрее бизнес

Понравился проект?

Хотите подобную работу? Оставьте заявку и мы отправим вам персональное

предложение!

Оставьте

заявку

Вы уже работаете с BI-системами?

Экстрактор данных 1С - инструмент для быстрой и безопасной выгрузки

данных из программы 1С или файлов Excel во внешнюю базу данных. Больше не нужно привлекать

программиста для настройки обмена и открывать внешний доступ к базе 1С.

Заказать демо